腾讯云:对AI算力、容器服务及弹性MapReduce(EMR)相关产品刊例价上调5%

财联社4月9日电,腾讯云发布AI 算力、容器服务、EMR 相关产品价格调整公告,鉴于全球AI算力需求持续激增,核心硬件供应链成本大幅上涨,为保障服务质量及算力资源的持续供给,腾讯云将于2026年5月9日起,对AI算力、容器服务及弹性MapReduce(EMR)相关产品刊例价进行调整。AI算力相关产品服务:上调5%;容器服务TKE-原生节点相关产品服务:上调5%;弹性MapReduce(EMR)相关产品服务:上调5%。

AI数据独角兽遭黑客攻击,一周内吃了5场官司,Meta紧急暂停合作

编译 | 陈佳

编辑 | 程茜

智东西4月9日消息,据外媒Business Insider昨日报道,美国AI训练数据平台Mercor遭黑客攻击,超过4万人的个人信息因此泄露,一周内被多名承包商在美国多地提起至少五起诉讼,指控其未能妥善保护个人敏感信息。

Meta已于4月4日暂停与该公司的全部合作,恢复时间未定;OpenAI同日称其正在调查专有训练数据是否受到波及。

这起事件起源于3月27日一场针对开源工具LiteLLM的供应链攻击,黑客组织TeamPCP通过植入恶意代码,在线上存续约40分钟内窃取受感染企业的云账号密钥、数据库密码及服务器访问凭证。

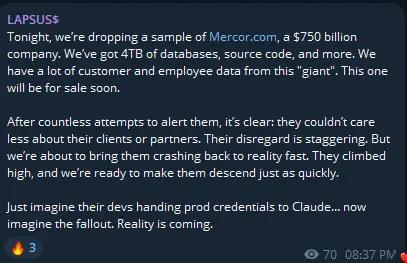

在Mercor3月31日确认泄露同日,另一个黑客组织Lapsus$宣称掌握4TB的Mercor数据,包括源代码、数据库记录和视频资料,并在暗网上公开叫卖。

在Telegram上挂牌出售的Mercor数据截图

Mercor成立于2023年,其客户涵盖Anthropic、OpenAI及Meta,主要招募医学、法律、文学等领域的专家,为AI公司的模型训练提供数据。该公司估值达100亿美元(约合人民币686.8亿元)。

此次泄露之所以令各家AI大厂紧张,不只是因为个人数据外泄,更是因为Mercor同时身处多家竞争对手的数据流水线之中,一旦数据选择标准、标注规范、训练策略等核心方法论细节被竞争对手获取,各家公司耗费数年、数十亿美元构筑的技术护城河将面临威胁。

事件发酵至今不足两周,Mercor已在美国多地收到五起诉讼。诉状指控该公司网络安全防护措施严重不达标。

一、三位22岁创始人的百亿帝国,在AI供应链安全的薄弱处被击中

Mercor由布伦丹·福迪(Brendan Foody)、阿达什·海尔马斯(Adarsh Hiremath)和苏利亚·米达(Surya Midha)三人于2023年创立,三人均毕业于旧金山湾区贝拉明预科学院,曾是同一支辩论队的队友。

Mercor三位创始人阿达什·海尔马斯(Adarsh Hiremath,左)、布伦丹·福迪(Brendan Foody,中)和苏利亚·米达(Surya Midha,右)(图源:Global Indian Times)

2025年10月,Mercor完成由风险投资机构Felicis Ventures领投的3.5亿美元(约合人民币24.038亿元)C轮融资,估值达100亿美元(约合人民币686.8亿元)。该公司三位创始人以22岁之龄同时跻身福布斯认定的全球最年轻的白手起家十亿美元富翁行列。

Mercor的商业模式是做AI大厂与领域专家之间的桥梁,负责招募医生、律师、科学家、记者等各类专业人士,为AI公司生产高度定制化的训练数据,每日结算额规模超百万美元。

Wired4月4日报道揭示了一个内部代号为“Chordus”的Meta项目,目标是训练AI模型利用多个网络来源核实信息,而这个项目目前已因攻击事件被迫暂停。

正是因为处于这一节点,Mercor的数据泄露后果格外棘手。多家机构共用同一家数据供应商,意味着一次攻击就能同时触及多家竞争企业的机密。

The Next Web指出,训练数据集或许可以复制,但训练方法论几乎不可能,而后者正是这次泄露最令人担忧的部分。

二、40分钟的窗口期,一个开源工具撬动整个AI供应链

这起攻击的技术核心是LiteLLM,一款用于将各类应用程序接入AI服务的开源Python库,每月下载量约9700万次,广泛存在于全球约36%的云环境中。安全公司Snyk的数据显示,LiteLLM每天被下载数百万次。

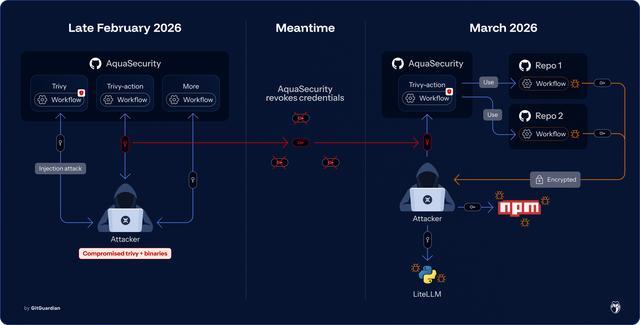

LiteLLM供应链攻击技术流程图(图源:GitGuardian)

3月27日,攻击者TeamPCP使用被盗的开发者凭证,向Python包索引(PyPI)发布了LiteLLM的两个恶意版本(1.82.7和1.82.8),这两个版本在被检测发现、下架之前,在线上存续了约40分钟。

针对开源工具LiteLLM的供应链攻击示意图(图源:Medium)

然而这短短40分钟足以让大量企业下载并部署受感染的版本。安全研究人员将此次攻击的源头追溯至更早期针对安全工具Trivy的入侵,攻击者TeamPCP通过攻破Trivy,获取了LiteLLM维护者的开发账号凭证,再凭借这些凭证直接登录PyPI发布了恶意版本。

Mercor在3月31日向内部员工发送的邮件中承认:“近期发生了一起影响我们系统和全球数千家机构的安全事件。”

该公司发言人海蒂·哈格伯格(Heidi Hagberg)告诉TechCrunch,安全团队已迅速采取措施遏制和修复事件,并引入第三方法证专家展开调查,但她拒绝就Lapsus$的声索或是否有客户数据被实际窃取等具体问题作答。

以社会工程和凭证盗窃著称的老牌勒索黑客组织Lapsus$,随后在其泄露站点上公开声称已入侵Mercor,并在暗网上挂出拍卖帖,声称持有4TB的Mercor数据,包括逾200GB的数据库、约939GB的源代码、3TB的视频和验证数据,以及该公司TailScale VPN账户的全部数据。

TechCrunch发现Lapsus$发布的部分样本,其中包含疑似来自Mercor内部Slack的数据、工单记录,以及两段据称展示Mercor AI系统与承包商对话的视频。

三、Meta无限期暂停合作,承包商突然失去收入来源

据Wired援引两名知情人士,Meta已暂停与Mercor的全部合作,且暂停期限不定。Meta对此未有任何公开声明。

OpenAI发言人告诉Wired,OpenAI正就其专有训练数据在此次事件中可能遭泄露的情况展开调查,并强调此次事件不影响任何用户数据,OpenAI目前也没有暂停与Mercor合作的计划。

Anthropic没有就外界的采访请求作出回应。谷歌同样在评估此次泄露的波及范围。

这场合作暂停对Mercor旗下承包商造成了直接冲击。据Wired发现的内部通讯,参与Meta相关项目的承包商在暂停期间无法记录工时,实际上已处于失业状态。

AI训练数据标注工作场景(图源:Getty Images)

Mercor试图将受影响的承包商调配至其他项目,但据知情人士透露,这些承包商起初甚至不知道合作被叫停的原因。

法律层面的事态发展迅速。4月1日,夏威夷瓦希阿瓦居民丽莎·吉尔(Lisa Gill)向美国加利福尼亚州北区联邦地区法院提起集体诉讼,称自己为处理此次泄露事件的后续问题耗费了大量时间,且面临更高的身份盗窃风险。

另一名承包商纳蒂维亚·埃森(NaTivia Esson)也递交了诉状,她自称于2025年3月至2026年3月间为Mercor工作,每次接单都需填写含个人信息的W-9税表,并“相信公司会采取合理措施保护这些信息”。

一周内,Mercor共收到五起诉讼。其中一起还将Berrie AI和合规机构Delve Technologies一并列为被告,LiteLLM由AI开发工具公司Berrie AI开发,此前持有由自动化合规认证机构Delve Technologies出具的SOC2和ISO 27001安全认证,诉状指控前者提供了存在安全漏洞的工具,后者出具了不实的安全认证背书。

上个月,Delve曾公开否认一篇匿名Substack文章中关于其协助伪造合规、安排虚假安全审计的指控。

根据法律研究机构Cornerstone Research对2018年至2021年间数据泄露和解案例的统计,此类案件赔偿金额通常在每位集体成员1至5美元(约合人民币6.87至34.3元)之间,有记录经济损失的受害者有时可获更多赔偿。

结语:AI数据外包暗藏结构性风险,一次攻击影响多家顶级实验室的护城河

目前,案件调查仍在进行,诉讼尚处早期阶段。这场针对Mercor的攻击暴露出AI产业一个结构性盲点。当多家顶级AI实验室将敏感的训练工作外包给同一家供应商时,这家供应商自身的安全漏洞就成了整个行业的共同风险暴露点。

安全公司Recorded Future的勒索软件分析师艾伦·利斯卡(Allan Liska)说,攻击者TeamPCP的动机明确是金钱驱动,并已公开表示将与勒索软件和勒索团伙合作,针对受影响企业发起规模化攻击。相比2023年Cl0p组织利用MOVEit漏洞一次性影响近1亿人的案例,AI训练数据领域的供应链攻击在商业损害维度上各有不同。

MiniMax发布命令行工具 MMX-CLI

隆基绿能与华为数字能源达成战略合作

每经AI快讯,4月9日,隆基绿能公众号消息,近日,隆基与华为数字能源技术有限公司正式签署战略合作协议。双方将在储能系统集成、智能组串式PCS以及清洁能源大基地解决方案等方面展开深度合作,携手推动全球储能产业高质量发展。

「评论」新能源汽车成“黑稿靶子”,AI不该沦为网络水军的帮凶

近年来,在国产新能源汽车快速崛起的过程中,相关领域也成为了网络水军的重灾区。去年底,烟台公安曾披露,其打掉一个炒作新能源汽车负面信息的团伙,这些负面信息波及的企业包括小米公司、华为鸿蒙智行、理想汽车等。警方一举抓获12人、查扣资金百万、关停账号8000余个。

该案如今有了更多的细节被曝光。据新华社报道,办案民警介绍,相较于过去以“造谣引流”“舆情敲诈”“有偿删发帖”等为目的的网络水军案件,新型网络水军不敲诈、不收费、不引流,利用AI技术等批量炮制“黑稿”,“量大管饱”,只挣平台流量费。

这也反映了当下网络水军犯罪呈现的新动向,同时也释放了一个危险的信号。当AI技术被黑产团伙掌握,新能源汽车这个承载着中国制造业升级希望的产业,正在成为“算法黑稿”的靶子。如果不及时大力度打击,未来势必会蔓延至其他行业,影响正常产业生态和经济发展。

传统网络水军的套路并不复杂:雇写手编造内容,养一批账号发帖,再通过人工或简单脚本刷量。这种模式成本高、效率低,而且容易留下明显痕迹——同一篇文章被几十个账号复制粘贴,连错别字都一模一样,平台审核人员一眼就能识别。

但AI水军完全不同。借助大语言模型和内容生成工具,操作者只需输入几个关键词,比如“某品牌新能源车”“刹车故障”“自燃风险”,AI就能在几秒钟内生成一篇逻辑通顺、用词多变、情绪煽动的“原创”文章。

更可怕的是,AI可以通过学习不同平台的爆款规律,自动调整标题风格、段落结构和情感倾向,使黑稿看起来像是一位普通车主的真实吐槽或“深度调查”。这种低成本、高效率的造谣模式,让谣言像流水线产品一样被不断制造出来,迅速污染舆论空间。

还有一点值得警惕,上述团伙的牟利模式已经形成完整闭环,不再依赖传统的敲诈勒索。他们不直接向企业索要钱财,而是通过大量注册、收购实名账号搭建矩阵,借助平台算法推荐机制,用夸张标题和极端内容博取点击、阅读与互动,从而赚取流量分成。

把抹黑当生意,把攻击当营收。在这种模式下,越是争议大、情绪浓、攻击性强的内容,越容易获得流量,也就越能带来收益。于是,新能源车企成为重点攻击对象,一篇篇毫无依据的黑稿被不断推送,误导公众、煽动对立,最终让造谣者坐收渔利。

这些网络谣言对企业则造成了更大的名誉伤害和经济损失。受害的车企称,这类负面信息严重损害企业品牌形象和生产经营秩序。以理想汽车为例,2025年8月订单锐减5000余辆,企业总市值下降约200亿元。

作为我国战略性新兴产业,新能源汽车正处于从政策驱动转向市场驱动的关键期,品牌竞争激烈。不排除有商业竞争对手暗中雇佣“水军”进行恶意抹黑,也不排除黑产团伙单纯为了流量和勒索而“碰瓷”热门企业。

无论动机如何,这种利用AI批量制造焦虑、误导消费者的行为,不仅损害具体企业的商誉,更可能让公众对国产新能源汽车技术产生不信任,破坏整个产业生态。

需要澄清的是,AI本身没有善恶。大模型不会主动想去“黑”哪个品牌,它只是在执行指令。问题的根源在于使用技术的人,以及放纵这种行为的平台生态。

部分平台的算法推荐机制客观上成了黑稿的“放大器”。AI水军深谙流量逻辑:标题越惊悚、情绪越极端、立场越鲜明,就越容易被推荐给更多用户。而平台的算法只看点击率、完读率和互动量,不问真假。从这个意义上说,AI是帮凶,算法推荐机制则是黑稿传播的“高速公路”。

因此,平台不能一边靠争议性内容赚流量,一边把责任推给算法。流量可以逐利,但平台必须守底线。

AI技术本应服务于信息生产的高效与多元,而不是成为网络水军批量制造谣言的帮凶。新能源汽车作为中国制造业的一张名片,经得起市场的检验和理性的批评,但经不起无休止的、由算法驱动的“定向抹黑”。

打击AI水军,不是要拒绝技术,而是要明确技术的边界和红线。当造谣的成本低到几乎为零,信任的成本就会高到无人承受得起。烟台警方打掉的新能源汽车黑水军团伙给全社会敲响了警钟:技术作恶的时代,治理手段必须比作恶者跑得更快。否则,下一个被AI“黑稿”瞄准的,可能是任何一个人、任何一个行业。

MiniMax发布面向AI Agent的命令行工具“MMX-CLI”

4月9日,MiniMax宣布发布一个面向AI Agent的命令行工具——MMX-CLI。据MiniMax介绍,接入MMX-CLI后,Agent可以在Claude Code、OpenClaw 等环境中原生调用MiniMax最新的编程、视频生成、语音合成、音乐创作等全模态模型,无需适配繁琐接口,也无需额外编写MCP Server。

阿里没浪费那场“林俊旸风波”

昨天,阿里方面内部信公布了一系列AI业务人员调整,李飞飞成为了阿里云新任CTO。

此李飞飞并非那位斯坦福出身的AI教母,而是阿里集团副总裁,阿里云/达摩院数据库业务的1号位。如果今天我们的主角是斯坦福的那位,那这篇文章就该讲World Lab的最新成果。

开个玩笑,回到阿里的这次调整,最核心的人员变动是原阿里云CTO周靖人卸任,由李飞飞接任。另一方面,吴泽明专注阿里巴巴集团CTO工作,淘宝闪购CEO职务由雷雁群接任。

乍一看,周靖人似乎地位有所下降,但仔细拆解这封内部信,实际上是阿里方面对于AI业务的整体规划,进行了一轮“三权分立“般的调整。

首先是通义实验室升级为通义大模型事业部,由周靖人全权负责,也就是说,整个大模型研发板块在阿里内部的规格进一步提高,周靖人虽然在CTO位置卸任,但旗下的模型业务的核心地位被进一步明确。

此外,阿里在集团层面设立技术委员会,由吴泳铭担任组长,成员包括周靖人、吴泽明、李飞飞。

其中,周靖人担任技术委员会首席AI架构师,李飞飞负责阿里云技术以及AI云基础设施建设,吴泽明负责集团业务技术平台以及AI推理平台建设。毫无疑问,这是阿里AI业务的一次“三权分立”式结构变化。

去年以来,阿里在AI业务层面动态不断,先是千问App卷土重来,与豆包、元宝在春节红包大战中正面厮杀。随后是Qwen模型核心人物林俊旸出走,当时阿里方面也不得不选择用一封内部信和一场高管露面的会议,来平息内部的质疑。

不到一个月前,阿里正式成立Alibaba Token Hub,也就是ATH事业群,由吴泳铭直接负责,核心目标被概括成“创造Token、输送Token、应用Token”。ATH覆盖通义实验室、MaaS业务线、千问事业部、悟空事业部以及AI创新事业部。

接下来就是今天的这场“三权分立”,只是在经历了业务和人员的多轮起伏后,这看起来是一场略显滞后的权力重组。

01

AI时代的野心的基础,还是模型

几周前,字母AI在《通义没有成为“阿里版Seed”》一文中曾写道:

“通义实验室并没有像Seed一样,被单独提升为类似“集团级研究中枢”的存在,而是被放进了一个以Token为核心的AI业务体系之中,成为ATH事业群的一部分。”

几周时间过去,阿里方面还是做出了进一步强化和聚焦模型业务的动作。

如果只看周靖人卸任CTO这件事,这确实是一起权责变化。但如果叠加阿里成立技术委员会,和通义大模型事业部的成立,其实不难发现,通义还是向字节的Seed团队模式靠拢,而周靖人的这次人事变动,也让他的地位更像是字节体系中的Seed1号位吴永辉。

简单回顾一下周靖人过往,他毕业于中国科技大学,2004年获哥伦比亚大学计算机博士学位,之后在微软任研发合伙人;2015年加入阿里,先做阿里云首席科学家,后来转到搜索推荐广告,再去蚂蚁,之后回到阿里云担任CTO并兼达摩院副院长。

在阿里的技术序列里,周靖人是一个跨云、跨算法、跨业务的人。他一度负责iDST,也就是达摩院前身的数据科学与技术研究院,后来又接过通义实验室。2025年底他进入阿里合伙人,也被视作管理层对其过去一年维持Qwen领先位置的肯定。

此外,作为阿里云CTO,周靖人在任内还是交出了一份不错的成绩。截至去年9月,通义已开源300多个模型,全球下载量超6亿、衍生模型超17万,并有超100万家客户接入;同期百炼平台模型日均调用量同比增长15倍。

所以,另一个解释似乎更合理。经历了林俊旸离职、Qwen团队重组的风波之后,阿里方面更希望周靖人能“钉”在模型这条线上了。

内部信给他的头衔是技术委员会首席AI架构师,通义实验室也升级为通义大模型事业部继续由他负责。尽管没有了CTO的Title,但是他也成为了阿里真正意义上的模型1号位。

再看李飞飞,阿里这次任命的不是斯坦福的那位AI教母,而是长期在阿里体系内做数据库和云基础设施的李飞飞。

他是阿里集团副总裁,曾任阿里云数据库产品事业部负责人、达摩院数据库与存储实验室负责人。

不过有一点,两位李飞飞有着相似之处,那就是都有着扎实的学术背景。

公开履历显示,李飞飞1997年从清华附中保送清华电机系,后赴新加坡南洋理工大学和波士顿大学深造,之后在美国高校任教,直至终身正教授,再进入阿里体系。

他的研究方向集中在数据库系统、大数据管理、系统分析以及云数据管理安全,后来当选ACM Fellow、IEEE Fellow、CCF Fellow等荣誉。

换言之,李飞飞不是一个典型的“讲AI故事”的人,而是典型的底座工程师。在阿里云CTO的位置上,他将负责推动AI云基础设施,支持AI云服务、以及模型侧的训练、存储、数据库、调度和推理资源的全链路效率。

换言之,李飞飞虽然接任了周靖人,但是二者看起来还是一个业务协同关系。

最后再来关注一下吴泽明,这位阿里集团CTO2004年加入淘宝,是阿里电商体系技术架构建设的核心成员,做过新零售技术事业群总裁、本地生活业务CTO、阿里集团CTO、达摩院副院长等角色,显然,他是一位从一线技术岗位成长起来的技术型高管。

所以,这份技术委员会的名单的意义很直接了,一方面阿里的技术底座和AI业务要强化协同,但这种协同变成了阿里云-通义-集团层面的三方协同。

三个人有点各司其职的意思,周靖人负责定义模型能力上限;李飞飞负责强化底座效率与成本结构,并且在云服务中进一步落地;吴泽明则在集团层面强化技术底座,同时协同其他业务与AI的融合。

技术委员会的组长是阿里CEO吴泳铭,在经历了模型团队重组期、又轰轰烈烈成立了ATH后,这位CEO终于腾出精力,梳理了阿里AI板块的权责分配。

至于究竟是主动拥抱未来,还是形势影响下的被动调整,那就不得而知了。

02

林俊旸离职的蝴蝶效应,还在继续?

过去几周内,阿里在AI业务的所有架构调整,都不可避免的让人联系到此前Qwen大模型负责林俊旸的离职。

很长一段时间里,相比起出生于1976年的周靖人,95后林俊旸被认为是阿里在模型侧的年轻一代领军人物。

在年初由清华主导的AGI NEXT论坛上,林俊旸曾代表阿里和Qwen与唐杰、杨植麟以及彼时备受业内关注的腾讯CEO首席科学家姚顺雨同台交流。

然而,林俊旸身上最有代表性的地方,不只是年轻,也不是“明星研究员”标签,而是他在业内为Qwen的开源技术路径积攒了不错的口碑,这一套以模型底座、开源社区和学术声量为核心的增长方式。

问题也恰恰出在这里。林俊旸离开后,阿里高层迅速召开内部会议,吴泳铭、蒋芳、周靖人都到场解释组织变化;而团队内部最焦虑的,不只是核心人物流失,而是Qwen究竟是继续围绕模型底座迭代,还是更深地为千问C端产品和阿里云商业化服务。

林俊旸的出走,一定程度上引爆这个问题在阿里内部的讨论。千问App此前传出认为Qwen模型团队不够支持,而Qwen团队又传出受限于Infra层的落后,无法匹配业内其他竞争对手。

而当ATH成立时,通义实验室、MaaS业务线、千问事业部、悟空事业部和AI创新事业部塞进一个更大的框架里,这个问题甚至变得更加复杂了。

通义实验室作为ATH的板块之一,如果要承接太多“赋能业务”的方向和需求,模型团队的长期目标势必会受到外界因素影响。

所以,林俊旸离职后的那场内部会上,传出 “Qwen是集团最重要的事情,希望人才来扩大,必然涉及到阵型变化。” 的信号时,基模团队的管理负担和压力,似乎就已经不是周靖人在CTO的位置上,能够“兼职”承担的了。

在阿里最新一季财报的电话会上,当被问及阿里AI优先级时,吴泳铭曾表示,打造智能能力最强的模型,是阿里AI优先级最高的,这是毋庸置疑的。

某种程度上来说,只要阿里想要聚焦基座模型发展,周靖人必然要成为绝对意义上的大模型1号位。

尤其是,阿里最新发布的Qwen3.6 模型里,似乎释放出了“闭源优先”的信号:核心能力(如 Qwen3.6-Plus)不开放权重,仅通过 API 收费调用,三款新模型均为闭源发布,直接服务商业变现 。同时仍保留小模型后续开源,形成“旗舰闭源、边缘开源”的双轨策略,本质是从开源驱动转向收入优先。

同时有行业分析显示,升级为事业部之后,通义事业部在给人才的职级、薪水上预计将有更大的自主性和决策权,在人才招聘和培养上将有更大的吸引力,更能吸引业内优秀青年科学家的加入。

这些业务和管理层级的变化,都需要团队负责人全身心投入。

另一方面,最近两个月,阿里股价从阶段高点回撤约30%–40%,上一份财报后单日多次下跌3%–9%,整体明显跑输其他科技股。

市场争议集中在AI投入:尽管云与AI收入同比增长约30%+,但大规模算力与补贴拉低利润,外界开始质疑其“高投入、慢回报”的商业化节奏。

而曾经挖走周畅等一系列阿里AI人才的字节跳动,在近期的估值飙升至超过6000亿美元的历史新高。这一增长主要受AI业务(豆包大模型)爆发等因素驱动,尤其是今年发布的Seedance2.0视频模型引发了业内的广泛关注。

这一背景下,进一步强化和明确模型研发部门的地位,无疑是阿里AI业务在ATH时代重整旗鼓的关键。

今天除了这则人事调整,还有一条值得关注的、疑似和阿里相关的AI界动态。

周二晚间,在知名 AI 评测分析平台 Artificial Analysis 上,一个代号为「HappyHorse-1.0」的神秘视频生成模型空降榜首,引发了 AI 社区热议。

目前有一个猜测是:HappyHorse 背后的团队来自阿里淘天未来生活实验室,由前快手可灵一号位张迪领导的团队。

如果消息属实,阿里的庞大架构下,蕴含的AI技术实力其实仍然是国内一流水平,甚至不仅仅局限在通义实验室内部。

只是,在ATH的大框架下,如何进一步推动资源协同,有效的利用好集团内的研发资源,平衡和整合基模团队的目标,这就是留给新成立的阿里技术委员会思考的问题了。

大三学生验证了罗福莉的“暴论”,我们和他聊了聊

2026年,“自进化”这个词被AI行业大拿高频提及。

小米MiMo大模型负责人罗福莉在3月的中关村论坛上直言:“如果要用一个词来概括接下来一年里AGI进程中最关键的一件事,我会选‘自进化’。”

罗福莉说,她一年前觉得大模型实现自进化需要3到5年,现在认为1到2年就能完成。

Anthropic的CEO阿莫迪比罗福莉还激进,他曾在达沃斯论坛上预测,AI的递归自我改进可能在6到12个月内实现,“我们可能距离AI自主构建下一代AI只有1到2年时间”。

这种自我改进一旦形成闭环,进步速度将呈指数级增长。

4月初就有这么一篇论文,刚好讲的就是如何让AI形成这么一个闭环,出自上海交大刘鹏飞教授团队,论文的标题是《ASI-Evolve: AI Accelerates AI》。

研究团队搭了一个闭环研究框架,让agent在“学习已有经验-提出新设计-做实验-分析结果”之间反复迭代,去自动改进模型架构、训练数据筛选、强化学习算法这三个AI核心部件。

AI会先学习过去的研究经验,再提出新方案,然后自己去做实验、分析结果,最后继续迭代,以此形成了闭环。

最终得出结果,AI真的能研究如何改进自己了。

诚然,这不是一篇足够改写整个AI产业的论文,它只是提出了一种方法。

不过真正让人震惊的是,这篇论文的第一作者徐为先,竟然还在上大三。

一个还未毕业的本科生,主导了如此一项完整且具有实际意义的研究……我了个豆!我的大学真是白念了!

于是字母AI还真就联系到了徐为先,通过邮件,我和这位阳光帅气的天才少年聊了聊。

01

天才少年徐为先

徐为先的技术背景覆盖面较广。

他不仅在AI研究领域关注神经架构搜索和持续学习,也做过一些系统编程的项目。

他能用Rust独立开发完整的操作系统内核ACore,用C++实现了性能媲美Clang的编译器Imxc,甚至用Verilog设计了基于Tomasulo架构的RISC-V处理器。

这种从底层硬件到高层AI算法的贯通能力,你别说放在本科生里了,哪怕是全栈工程师来了也够呛。

他的GitHub项目ASI-Arch已经获得1100多个星标,对一位大三学生来说,这个成绩是相当出众的。

抛开这些技术,徐为先对AI研究也有自己的思考。他认为要实现“能够自我进化的AI”(Self-Evolving AI),当前的AI还缺乏两个能力,分别是“持续自我改进”和“长期可靠性”。

因此他的研究分为两条战线:改进单个模型的学习目标和记忆机制,使其能够持续成长;构建多智能体生态系统,让模型通过复杂的交互协议协作优化。

谈到ASI-Evolve的研究起点,徐为先说那是2025年4、5月份关注到Google的AlphaEvolve时产生的一个直觉。当时那项工作让人们看到AI不再仅仅是帮人类做简单的检索,而是具备了推动科学发现的潜力。

“我们当时便希望能将这种范式应用于AI研究本身。”徐为先说,“这个想法的关键在于:既然AI技术在飞速发展,如果能将其成果反哺到自身的科研进程中,就能让整个领域进入一个规模宏大的自我加速循环。这种迭代式的进步,是我认为这个方向最迷人的地方。”

徐为先也承认,这个想法的实现离不开上海交大GAIR实验室的支持。

他很感谢刘鹏飞老师,称他非常鼓励本科生探索和研究,提供了大量指导,实验室丰富的资源让他们得以完成如此庞大的探索。

其实像普通大众对这类论文最容易产生误解,他们会认为研究者正在试图用AI彻底替代人类科学家,但这是完全不对的。

徐为先说:“在ASI-Evolve中,我们引入了大量的人类先验经验。我们并不追求脱离人类指引的‘盲目进化’,因为最初的实验目的和核心设想始终是由人类提出的。系统的真正价值在于利用AI极强的探索能力,在人类指引的方向上进行极速迭代。它更像是一个极其高效的协作系统,而非某种冷冰冰的替代品。ASI-Evolve推动着人们从问题解决、修复向问题定义转变。”

关于“天才”这个词,徐为先的理解相当平实。他认为天才是热爱、天赋与努力的结合。

“每个人都有自己潜在热爱和擅长的事情。我们需要做的是找到热爱与擅长的交集,从而在综合而言更好的方向上,通过持续的努力取得成功。”

他说,“我们看到很多公认的天才,不仅是他们成就过人,也因为他们所在的领域更被大众熟知,但‘三百六十行,行行出状元’,只要一个人能找到感兴趣的东西并为之付出,他也会成为自己热爱领域里的天才。”

徐为先谦虚地认为自己是相对平凡的。

他对科研充满兴趣,希望在自己喜欢的领域有所成就,但也希望能够享受生活,希望能够感受到身边的美好。“尽管研究的过程中挫折占了大多,但还是期待着Happy Research。” 徐为先说道。

徐为先最让我感到诧异的,是作为一个研究者,他在面对学术的同时,依然保持着年轻人独有的那份对生活的热忱。

他是吉他手,同时玩古典和电吉他,拥有单簧管九级证书,喜欢打羽毛球和电子游戏。

不仅如此,他在个人主页上坦诚地提到自己正在恋爱中,珍惜与伴侣共同探索人生旅程的时光。这种技术天才与生活的平衡,让人看到一个立体而真实的年轻研究者形象。

我相信你跟我一样,也会对这位阳光小青年感到羡慕。

对于未来的研究方向,徐为先更期待看到AI在反思和持续学习方面取得突破。“我并不特别关注现在训练出的每一代模型能力的提升幅度,因为现有的很多模型已经能满足大部分的日常需求了。”

他说“我更加关心的是一个模型在整个生命周期中的表现,无论是在训练中还是在部署使用的过程中——或者说未来可能根本就不再区分训练和部署阶段。AI到底能不能持续地提升自己,这不仅关乎到一个模型能力的上限,也是真正提升个性化能力、让模型进一步适合每个用户的关键。”

每个人有自己的表达风格和独特需求,模型只有在真实的使用场景中持续动态进化,才能更好地适配用户,这一点或许是纯靠静态数据集训练难以实现的。除此之外,如何实现模型更强大的智能体能力也令人兴奋。如果说持续进化是在探索智能的潜力,这个就是让现有的模型更全面地与世界交互。

这也是徐为先本科毕业后打算继续读博的原因。他希望在读博期间能做那些自己感兴趣,又能真正回归社会、让所有人都能实际使用的技术。

02

ASI-Evolve

徐为先认为,将研究进步从“人类受限”转变为“计算可扩展”的过程就是ASI-Evolve框架的哲学基础。

什么叫人类受限?开发一个新的神经网络架构,需要博士生花3个月尝试100种设计。

什么叫计算可扩展?ASI-Arch项目进行了1773次自主实验,消耗超过20000 GPU小时,最终发现了106个创新的SOTA线性注意力架构。只要提供算力,AI就会不断地研究。

ASI-Evolve论文的核心贡献,在于首次在统一框架下系统性地证明了“AI加速AI”的可行性。这是在神经网络架构设计、预训练数据筛选、强化学习算法设计三大领域同时取得的突破。

在神经网络架构设计方面,表现最好的模型实现了0.97%的提升,这个数字接近当前人类设计SOTA增益的3倍。

更重要的是,这些架构不是通过暴力搜索得到的,而是通过系统的“学习-设计-实验-分析”循环自主演化而来。

系统会先学习过去的研究经验,理解哪些设计原则是有效的,然后在此基础上提出新的架构方案。每一轮实验的结果都会被分析提炼,写入经验数据库,为下一轮探索提供指导。

这种方式让AI能够像人类研究员一样积累知识,而不是每次都从零开始。

实际上用AI研究AI,用AI改进AI,是现在非常火的一个赛道,上到Anthropic、OpenAI这样的头部公司,下到小团队、实验室,都瞄准了这个领域。

除了前面徐为先提到的AlphaEvolve,最近很火的Sakana AI实验室也提出过一个类似的构想,叫做The AI Scientist。

它的逻辑也是让AI自己想题目、写代码、跑实验、分析、写论文。

咱们回到徐为先的ASI-Evolve上来。

在预训练数据筛选领域,AI自主优化的数据策略在平均基准测试中提升了3.96%,而在知识密集型的MMLU评测中,提升幅度超过了18%。

这意味着AI已经能够理解什么样的数据对训练更有价值,并自主完成数据清洗和筛选的全流程。传统的数据筛选依赖人类专家的经验判断,需要大量人工标注和质量评估。ASI-Evolve则能够通过实验反馈自动学习数据质量的判断标准,在海量数据中找出真正有价值的训练样本。

在强化学习算法设计方面,ASI-Evolve设计出的全新训练算法在数学竞赛题上的表现亮眼。在AMC32上超越GRPO基线12.5分,在AIME24上超越11.67分,在OlympiadBench上超越5.04分。

这些不是简单的参数调优,而是具有原创性数学创新的全新算法机制。系统能够理解现有算法的局限性,提出新的优化目标函数,设计新的梯度更新策略。

ASI-Evolve的意义在于,它展示了AI自己研发AI的可能性。

过去,AI的每一次进步都依赖人类研究员在架构设计、数据清洗、算法调优上投入的海量人力。

我们都在说AI替代人,但这条赛道非常特殊,你如果想要AI进步更快,就只能招更多研究员。

现在,AI开始在这些核心环节中形成闭环,直接参与自身的进化。

传统模式下,研究产出受限于人类研究员的数量和工作时间。即使是最优秀的研究团队,一年能尝试的数量也是有限的。

ASI-Evolve则将这个约束从人力转移到了算力。只要有足够的GPU资源,系统可以7×24小时不停地探索,尝试的方案数量可以是人类团队的数十倍甚至上百倍。

但这并不意味着人类研究员变得不重要。

徐为先强调,ASI-Evolve中引入了大量的人类先验经验。系统的认知库中存储了人类研究文献中的设计原则和经验教训,这些知识为AI的探索提供了方向。

最初的研究目标和评估标准也是由人类设定的。AI的作用是在人类指引的方向上进行高效探索,而不是盲目地搜索整个可能空间。

这样一来你就不再需要花大量时间在具体的实验和调参上,而是可以专注于思考什么样的问题值得研究,什么样的方向更有前景。

AI则负责将这些高层次的想法转化为具体的技术方案,通过大规模实验找到最优解。

ASI-Evolve的另一个重要特点是它的分析器模块。

这个模块能够将复杂的实验结果提炼成可复用的洞察。

传统的自动化实验系统往往只能输出原始数据,需要人类研究员花大量时间分析。ASI-Evolve的分析器则能够自动识别实验中的关键模式,总结哪些设计选择是有效的,哪些是无效的,并将这些洞察写入经验数据库。

这让系统能够真正地“学习”,而不只是“搜索”。

就像刷题一样,普通人刷题,最后就会记录一个数据,这1000道题里我对了多少道题,错了多少道题。但是ASI-Evolve,它不仅会记录错题数量,还会记得为什么错,下次遇到类似的题目应该怎么才能选对。

如果我们往大了去说,过去一百年,科学研究的模式基本没有改变。

人类提出假设,设计实验,分析结果,发表论文。

这个循环的速度受限于人类的认知能力和工作时间。

如果ASI-Evolve的这种模式能够推广到更多领域,可能会从根本上改变科学研究的速度和规模。

03

天才少年争夺战

AI时代像徐为先这样的天才少年越来越多,

随之而来的,是各大厂商的招募策略正在发生根本性变化。那些顶级厂商开始提前锁定、深度培养还在读书的天才少年。

比如月之暗面的“穿越计划”。

实习生在通过3到6个月的考察后,即使尚未正式毕业,也可获得该计划的正式offer与对应激励。关键是它这个除了给奖金以外,还会给公司期权。

月之暗面去年12月的时候,估值是43亿美元。到了今年3月,它的估值就来到180亿美元了。这样的成长速度下,它的期权还是相当诱人的。

该计划几乎没有任何硬性条件限制,不限专业、不限学历、不限经验,只看你是否是“任何领域最TOP的人才”。

从公司角度看,提前一年锁定人才,意味着在竞争对手还在观望时就已经完成了布局。

OpenAI的Safety Fellowship则代表了另一种模式。这个从2026年9月14日到2027年2月5日运行的项目,邀请外部研究者、工程师和实践者专注于AI安全与对齐研究。

入选者将获得月度津贴、计算资源支持,以及来自OpenAI导师的深度指导。项目期望参与者在结束时产出实质性的研究成果,比如论文、基准测试或数据集。

这两种模式看似不同,实则有着共同的逻辑:给你导师、给你资源、给你算力,最后还给你钱。

一方面,它们给了年轻人一个机会。

这不是传统意义上的“培养”,而是把最优秀的年轻人直接投入到最前沿的战场,让他们在真实的挑战中快速成长。

另一方面,它也是大公司广撒网寻找人才的新方式。

AI是一个比较新的产业,过去的量化标准对它不起效果,所以这些大公司必须地用这种新鲜手段来寻找奇才良将。

这种招聘策略的转变,反映了AI行业发展的一个深层次变化。

随着工具和框架的成熟,真正稀缺的不再是技术积累,而是创新思维和执行能力。一个有想法、能动手的新人,可能比一个循规蹈矩的博士更有价值。

这些品质在传统的学术训练中很难培养,却是AI时代最需要的素质。

还有一点咱们也得承认,那就是这场天才少年争夺战背后是AI行业对未来的焦虑。

当前的AI发展速度已经超出了大多数人的预期。这才导致了培养人才的速度,跟不上推动技术的速度。

各大公司都在赌未来,人才是这场赌局中最重要的筹码。谁能提前锁定最优秀的年轻人,谁就能在未来的竞争中占据优势。

在AI赛道“慢半拍”的腾讯 能否凭“脚手架”理论突围?

《科创板日报》4月9日讯(记者 李佳怡)借势“龙虾”,腾讯赶场入局。

2026年春,OpenClaw掀起 “全民养虾”热潮,让腾讯罕见地站上了AI应用层的风口。一个月内,WorkBuddy、QClaw、CodeBuddy等十余款Agent产品密集上线,微信、QQ、企业微信等全线打通。

热闹背后,一个更深层的战略轮廓正在浮现:腾讯并非在追逐一时的“龙虾”热度,而是在加速落地一套以超级入口和工程化能力为核心的AI追赶路径。

▎“慢半拍”的腾讯,正在加速“补课”

腾讯在自研大模型上的滞后,已是公开的秘密。

2025年初,DeepSeek的爆火给腾讯带来直接冲击。元宝接入DeepSeek后一个月内,日活增长约20倍;2026年初,腾讯也豪掷10亿元红包为元宝APP引流,但效果相对有限。

市场有声音认为,用户更多是冲着DeepSeek开源模型和现金红包留在元宝APP,这在某种程度上因为反映了混元还未能完全满足用户的预期。

腾讯并非没有意识到问题的严峻。李强在接受《科创板日报》记者采访时也坦言,如果模型处于比较好的位置、性能比较强,留住客户的能力也相对较强。

“首先把精力放在‘引擎’的研发上面,当然我们也承认我们今天还有很多的路要走,我们也在补课,但补课的进度是比较快的。”李强强调道。

在3月腾讯披露的2025年全年业绩报告中,“AI”一词贯穿始终。数据显示,2025年腾讯全年资本开支达792亿元,研发投入857.5亿元,均创下历史新高。

腾讯总裁刘炽平也透露,2026年腾讯预计还会增加资本开支,获取算力支撑模型训练和推理,同时有额外的算力对外租售。“去年腾讯在AI新产品上投入了180亿元,今年至少翻倍。”

与此同时,腾讯在人才和组织上密集补强。

2025年底,腾讯先后引入了OpenAI前研究员姚顺雨担任首席AI科学家、原新加坡Sea AI Lab高级研究科学家庞天宇任混元首席科学家。2026年3月,有消息称腾讯AI Lab被撤销,部分人员并入混元团队。这也意味着,腾讯正在将所有AI研发力量集中到大模型主线上。

然而人才引进、组织调整,也难以瞬间缩小时间差问题。混元3.0要等到4月才正式发布,而字节的豆包、阿里的通义已经完成了多轮迭代和生态渗透。

可以看到,当前腾讯的选择是,在底层模型追赶的同时,借助“龙虾”的东风,用应用层产品矩阵抢占入口,用工程化能力放大现有模型的效果。

▎借“龙虾潮”东风:抢占入口、搭建“脚手架”工程

OpenClaw作为开源框架,让所有厂商站在同一起跑线上。腾讯的优势不在于模型,而在于微信、QQ、企业微信构成的国民级超高流量入口,以及由此延伸的整个产品生态。

在这场席卷行业的“百虾大战”中,腾讯的布局看似是顺势追赶热点,实则真正意图是通过“龙虾”带动云服务、SaaS等核心业务协同,形成“入口+基础设施+应用”的闭环。

在财报媒体会上,马化腾首次公开谈及“养虾”构想,其认为“龙虾”应用能够让AI落地到各种丰富的场景中,而不像过去那样完全集中在ChatBot里,能够更好地发挥腾讯的产品矩阵和生态优势,也为目前正在开发中的微信Agent带来了一定的启发。

腾讯集团副总裁李强在接受《科创板日报》采访时同样认为,OpenClaw的出现,是一个非常重要的分水岭。在他看来,AI从对话走向可执行,让AI的价值变得直观,同时应用场景的丰富也能为企业带来价值。“因此,这是我们快速跟进的非常重要的原因之一。”

据《科创板日报》记者统计,自2026年3月起,腾讯密集推出的“龙虾”Agent应用已形成覆盖个人桌面、企业部署及生态平台的全链条矩阵,并打通了微信、QQ等超级流量入口。截至2026年4月,腾讯推出了十余款AI Agent产品与平台服务。

其中,个人桌面类包括QClaw、WorkBuddy、会议/文档等Skill化工具;企业级涵盖乐享2.0、企点营销云MAGIC Agent 2.0、TC Data Agent、ClawPro;研发与生态平台有CodeBuddy、ADP智能体开发平台,以及安全工具“龙虾管家”、SkillHub技能社区等等。

值得一提的是,在3月底的腾讯云峰会上,腾讯集团高级执行副总裁汤道生针对AI Agent的发展从技术层面给出了更系统的阐述,其提出“Harness(脚手架)”理论。

他认为,主流大模型的能力差距正在逐步缩小,企业的核心需求已不再是拥有最好的模型,而是如何通过模型的Harness,包括工具调用、分层上下文工程、长记忆管理、工作流设计等系统工程手段,在不改变模型架构和参数的基础上,把模型能力最大程度发挥出来。

这套思路已经体现在腾讯的AI产品布局中,腾讯云智能体开发平台ADP,通过RAG、知识库等能力给智能体连接上“图书馆”;Claw作为神经中枢运行于Agent Runtime安全沙箱,从技能库发现并调用Skills,触发行动;Agent Runtime的沙箱方案还可用于大模型强化学习的程序结果验证,提升强化学习的训练效率。

需要注意的是,这种工程化能力并非腾讯独有,阿里、字节等友商同样具备,开源社区也在快速跟进。因此,补齐底层模型能力对腾讯至关重要。当模型能力相当时,入口和Harness是护城河;一旦对手模型明显更强,这套体系反而会变成“更高效的漏斗”,用户进来后发现体验不如竞品,就会转身离开。

▎“龙虾”退潮后,模型能力与生态闭环是竞争关键

“龙虾热的现象最终会过去。”腾讯云AI智能体产品总监黄广民向《科创板日报》记者坦言。

事实上,这股热潮确实来得快去得也快。微信指数显示,“龙虾”一词的热度在3月6日飙升后,于3月11日前后达到顶峰,随后迅速回落。人工智能社区Huggingface首席执行官Clément Delangue也早在3月13日就预测,OpenClaw的热度六周后就会褪去。

正如上文所述,腾讯意在借助此轮“龙虾潮”,构建“入口+基础设施+应用”的闭环。

然而这个闭环的每一环,都有强敌环伺。底层有阿里、字节的算力竞争,应用层有飞书、钉钉的办公场景争夺,模型层有DeepSeek、智谱的开源围剿。腾讯的“全栈”能否转化为“全胜”,还有待观望。

值得注意的是,伴随“龙虾”浪潮,Token消耗量成为行业焦点。多家云服务商推出价格补贴和激进考核指标,行业陷入内卷。相比之下,腾讯态度克制。

李强向《科创板日报》记者表示:“衡量AI产品,Token是很重要的指标,但绝不是唯一指标。”他打了个比方:“将Token假定为汽车的油耗,如果只关注油耗,不关注引擎的经济性与输出能力,客户最终一定会舍弃。还是要更关注产品本身,有一个好用的AI的产品,客户能够从中获得价值,自然而然就会产生Token的真实消耗。”

当市场的狂热退潮,当“养虾”从新鲜事变成日常操作,真正的较量才刚刚开始。腾讯的底牌很清晰,微信的超级入口、产品矩阵的协同能力、以及对“工程化”而非“模型参数”的务实聚焦。

然而,底层模型的短板依然突出。腾讯能否真正缩小这一代差,答案或许要等到混元3.0正式发布才能揭晓。

据汤道生透露,混元3.0一方面激活参数大幅降低,体验更优,另一方面在复杂推理、长记忆、长文、多轮追问与Agent能力等多个维度,有明显的提升。“在元宝中做实验测试,正向收益非常明显。”

这场席卷行业的 “龙虾潮”,成为腾讯在AI赛道补位的关键契机。当热潮散去,AI竞争终会回到模型实力与生态闭环的核心较量,腾讯的全栈布局能否真正站稳脚跟,仍待市场与时间检验。